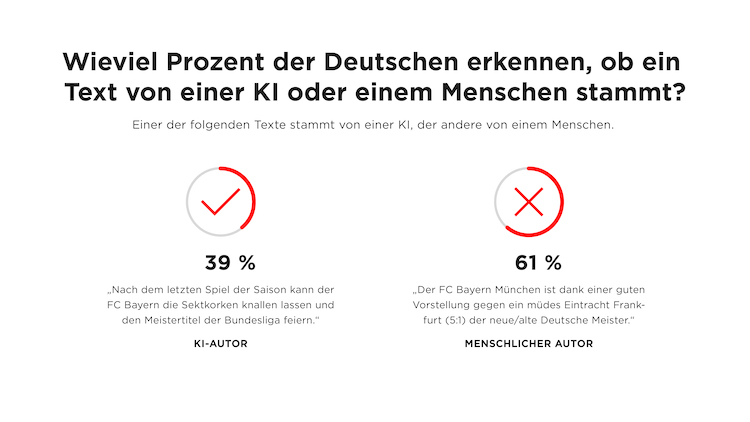

Weitere 50 Prozent wissen nicht, ob sie einen Unterschied erkennen könnten. Und in der Tat: Nur 39 Prozent haben den richtigen KI-Text im Test identifizieren können

Auch die Glaubwürdigkeit von automatisch erstellten Texten führt zu Verunsicherung bei den Bundesbürgern: Während 43 Prozent KI-Nachrichten für glaubwürdig halten, hegen 57 Prozent Zweifel.

Weniger Angst vor Künstlicher Intelligenz als vor Programmierern

Dabei scheinen die Befragten weniger Angst vor der KI an sich als vor den Programmierern dahinter zu haben: So befürchten 54 Prozent, dass Entwickler die KI für eine eigene Agenda missbrauchen könnten.

Weiteren 62 Prozent gefällt es nicht, dass eine Künstliche Intelligenz nicht für Inhalte verantwortlich gemacht werden kann.

Zusammenfassend zeigt die Studie: Die Akzeptanz von Künstlicher Intelligenz hat innerhalb eines Jahres deutlich zugenommen. Dabei entpuppen sich Kurzmeldungen wie Wetterberichte oder Verkehrsinformationen als beliebte, vorstellbare KI-Formate.

Wunsch nach klaren Leitlinien

Gleichzeitig wünschen sich die meisten Deutschen klare Leitlinien für den Umgang mit Künstlicher Intelligenz und entsprechende Hinweise, wenn sie zum Einsatz kommen. Denn obwohl sie sich wünschen, dass automatisch erstellte Beiträge auch als solche identifizierbar bleiben, werden KI-Texte nicht mehr so einfach erkannt.

Diese online-repräsentative Studie wurde im Vorfeld des scoopcamp, der Innovationskonferenz für Medien, von Statista im Auftrag von nextMedia.Hamburg zwischen dem 25. Juni und 30. Juni 2019 durchgeführt.

Insgesamt haben 1.000 Personen teilgenommen, die zu 50,4 Prozent männlich und zu 49,6 Prozent weiblich sind. Die Studie ist der dritte Teil des Media Innovation Reports von nextMedia.Hamburg.

Fotos: obs/dpa Deutsche Presse-Agentur GmbH/scoopcamp/dpa